Ông Simon Harari, Giám đốc phụ trách Chính sách nội dung, Facebook Châu Á Thái Bình Dương (ảnh: Bizlive)

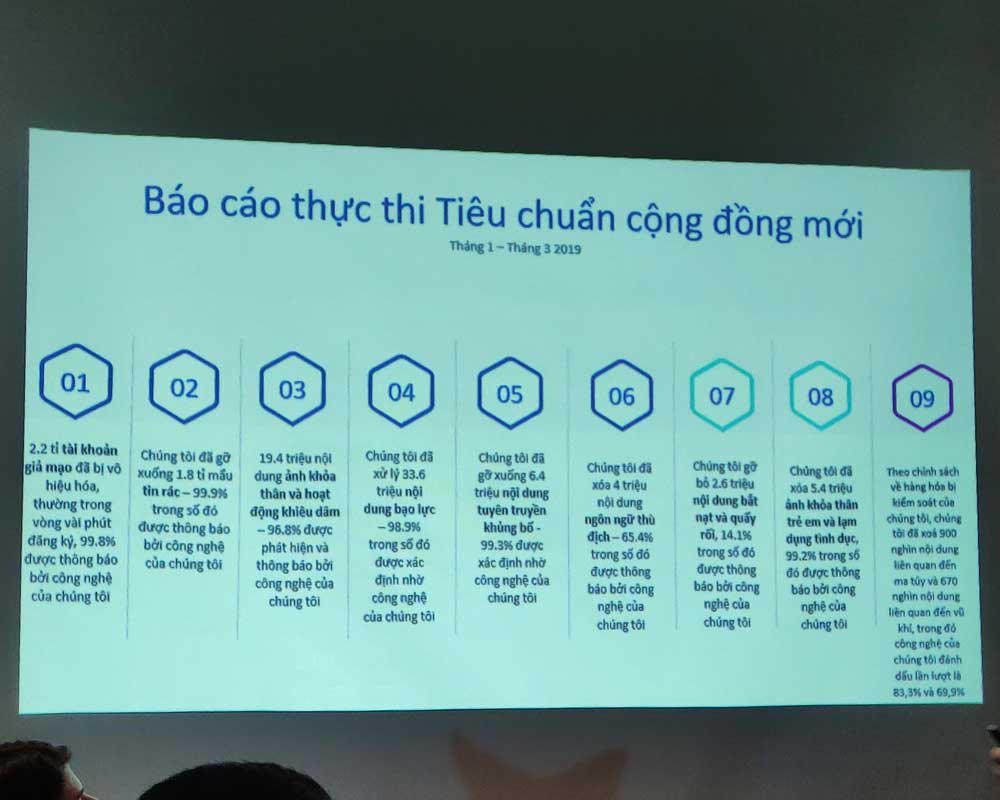

Ngày 18/6/2019, ông Simon Harari, Giám đốc phụ trách Chính sách nội dung, Facebook Châu Á Thái Bình Dương đã có buổi gặp gỡ với truyền thông Việt Nam để chia sẻ về bộ tiêu chuẩn cộng đồng của Facebook.

Tiêu chuẩn cộng đồng của Facebook là các quy tắc chỉ ra những gì có thể và không thể chia sẻ trên nền tảng. Các quy tắc này được tạo ra nhằm hướng tới một môi trường lành mạnh, nơi mọi người cảm thấy tự do và an toàn để thể hiện bản thân, được cân nhắc với 3 nguyên tắc cốt lõi: An toàn, Tiếng nói, Công bằng....

Những tài khoản Facebook có hoạt động live stream (phát trực tiếp) thu hút đông đảo người theo dõi, phần mềm kiểm duyệt của Facebook ngay lập tức giám sát tại thời điểm video được phát sóng nhằm ngăn chặn nội dung vi phạm chính sách của mạng xã hội này.

Ông Simon Harari khẳng định, Facebook áp dụng chính sách “chung thân” đối với bất kỳ tài khoản nào vi phạm chính sách của Facebook như: đăng tải thông tin có nội dung kích động khủng bố, bạo lực, khiêu dâm,… một khi tài khoản đã bị xóa sẽ không bao giờ được phép khôi phục.

Về vấn nạn tin giả gây nhức nhối hiện nay, Facebook có một hệ thống giải quyết qua việc lọc bỏ, giảm thiểu thông qua tin báo. Tuy nhiên, ông Simon Harari thừa nhận không phải tất cả những tin giả đều được Facebook loại bỏ.

Nhưng nếu Facebook biết những tin giả đó đến từ tài khoản giả mạo, hoặc những tin đó có liên quan đến nguy cơ trong đời thực (nạn nhân có thể tự tử vì những thông tin giả mạo nhắm đến mình), chắc chắn sẽ bị Facebook loại bỏ.

“Với những thông tin Facebook không thể nhận biết chắc chắn là thật hay giả, chúng tôi sẽ có tác động để giảm thiểu mức độ tiếp cận người dùng đối với thông tin đó. Trên thực tế thông tin đó vẫn tồn tại nhưng số lượng người nhìn thấy giảm đến 80%.” ông Simon Harari nói.

Facebook đã xử lý hàng loạt tài khoản vi phạm tiêu chuẩn cộng đồng (ảnh: ICTNews)

Trả lời câu hỏi công cụ “Báo cáo” (Report) của Facebook có thể bị lợi dụng khiến không ít người bị khóa tài khoản bởi một nhóm người có dụng ý xấu. Ông Harari cho biết người dùng bị xoá nội dung có thể kháng nghị lên Facebook để mạng xã hội này một lần nữa kiểm tra lại bằng con người và đưa ra quyết định cuối cùng.

Còn với những tài khoản đã bấm nút “Report”, Facebook cũng có cơ chế kiểm tra lại các hành vi trước đây của tài khoản. Nếu hành vi Report này diễn ra một cách có hệ thống và trên một diện rộng hay từ một tài khoản giả mạo người khác, Facebook sẽ xóa các tài khoản này.

Facebook cho biết hiện có 15.000 nhân viên, sử dụng hơn 50 ngôn ngữ, trong đó có tiếng Việt, chịu trách nhiệm xem xét các nội dung được báo cáo có khả năng vi phạm.

Những người kiểm duyệt này là một phần của một đội ngũ lớn hơn gồm hơn 30.000 người trên khắp thế giới có nhiệm vụ tập trung vào sự an toàn và bảo mật. Dựa trên các phản hồi toàn cầu, Facebook cập nhật chính sách về tiêu chuẩn cộng đồng hai tuần một lần.

Với những người dùng, đại diện Facebook cũng cho biết một trong những cách để ngăn chặn các thông tin xấu lan truyền trên mạng xã hội đó là chính người dùng nên thận trọng. Facebook từng đưa ra chiến dịch giúp người dùng nâng cao nhận thức, biết phân biệt các thông tin nào là đúng và có trách nhiệm trước khi Like, hay chia sẻ một nội dung nào đó.

Bá Di (Tổng hợp)